ChatGPT 구매대행 보안 이슈 완벽 정리: 계정 공유부터 데이터 유출까지

ChatGPT 구매대행을 통해 계정을 구입하면 비용은 절약되지만, 데이터 유출과 계정 정지라는 심각한 보안 위험이 뒤따릅니다. 실제로 2023년부터 2025년까지 다크웹에서 거래된 ChatGPT 유출 계정은 22만 5,000건을 넘었고, 삼성전자는 ChatGPT를 허용한 지 20일 만에 기밀 유출 사고가 발생하여 전사 사용을 금지한 바 있습니다. 한국인의 74%가 AI를 사용하고 ChatGPT 월간 활성 사용자가 2,162만 명을 돌파한 지금, 구매대행의 보안 이슈는 개인과 기업 모두에게 중대한 문제입니다.

이 글에서는 ChatGPT 구매대행의 구조적 보안 취약점 5가지, 실제 피해 사례, 그리고 기업이 ChatGPT를 안전하게 도입하는 방법을 구체적으로 정리합니다. ChatGPT 회사에서 사용할 때 주의사항과 함께 읽으시면 더욱 도움이 됩니다.

ChatGPT 구매대행이란 무엇이고 왜 위험한가?

ChatGPT 구매대행은 개인이나 업체가 OpenAI 유료 구독을 대신 결제해주거나, 하나의 계정을 여러 사용자가 나눠 쓰도록 중개하는 서비스입니다. 피클플러스, 겜스고 같은 공동구독 플랫폼이 대표적이며, 비공식 대리결제 업체도 다수 존재합니다.

문제는 이 과정에서 계정 소유권, 데이터 접근 권한, 보안 책임이 모두 불투명해진다는 점입니다. OpenAI 이용약관은 계정 공유를 명시적으로 금지하고 있으며, 위반 시 계정 정지나 영구 차단이 가능합니다.

구매대행의 3가지 유형

| 유형 | 방식 | 위험도 | 주요 문제 |

|---|---|---|---|

| 공동구독 플랫폼 | 1개 계정을 여러 명이 공유 | 매우 높음 | 대화 내역 혼재, 개인정보 노출 |

| 대리결제 업체 | 해외 결제를 대신 처리 | 높음 | 결제 정보 노출, 계정 관리권 불명확 |

| 비공식 리셀러 | 대량 구매 후 재판매 | 높음 | 계정 소유권 분쟁, 갑작스러운 서비스 중단 |

특히 공동구독 플랫폼의 경우, 실제 사용자들 사이에서 “ChatGPT가 다른 사용자의 이름을 혼동하거나, 타인의 대화 내용이 노출된 사례”가 보고되고 있습니다. 이는 단순한 불편을 넘어 심각한 개인정보 침해에 해당합니다.

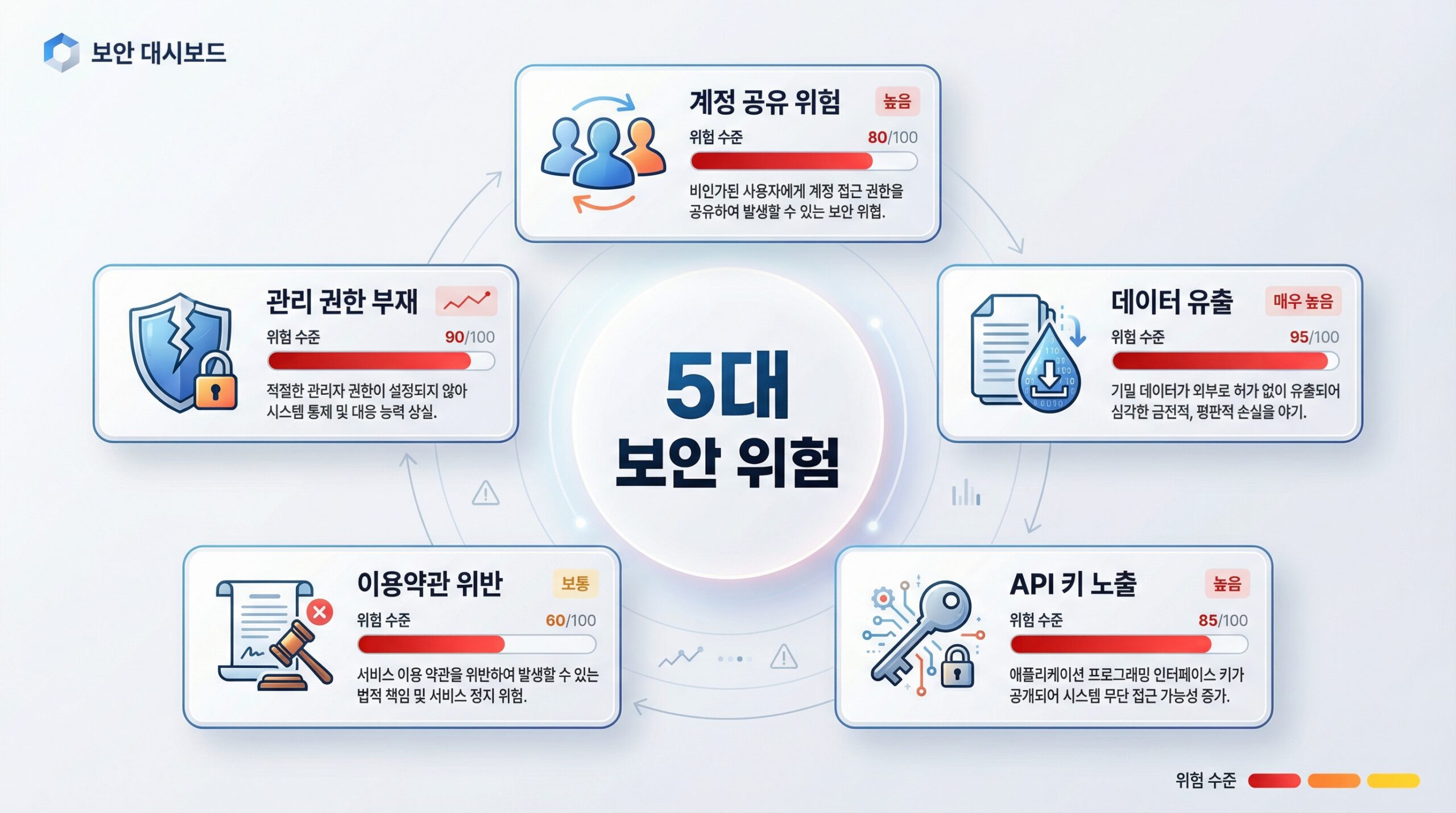

구매대행 시 발생하는 5가지 핵심 보안 위험은?

ChatGPT 구매대행을 이용하면 다음 5가지 보안 위험에 노출됩니다. 각 위험의 구체적인 내용과 실제 발생 가능한 피해를 살펴봅니다.

1. 계정 공유로 인한 대화 내역 노출

공동구독 플랫폼에서 하나의 ChatGPT 계정을 여러 사용자가 공유하면, 다른 사용자의 대화 내용이 노출될 수 있습니다. ChatGPT는 사용자의 이전 대화를 기반으로 맥락을 파악하기 때문에, 여러 사람이 같은 계정을 사용하면 AI가 사용자를 혼동하거나 이전 사용자의 질문과 관련된 정보를 노출할 수 있습니다.

실제로 공동구독 플랫폼 이용자들은 “ChatGPT가 내 이름이 아닌 다른 사람의 이름을 부른 적이 있다”, “질문과 무관한 답변이 나와서 확인해보니 다른 사용자의 대화 맥락이었다”라고 보고하고 있습니다. 이는 ChatGPT 계정공유 및 동시접속 시 주의사항에서 자세히 다루고 있습니다.

2. 기업 기밀 데이터 유출 위험

구매대행 계정으로 업무에 ChatGPT를 활용하면 입력한 데이터가 외부로 유출될 수 있습니다. 보안 기업 eSecurity Planet의 조사에 따르면, AI 사용자의 77%가 기업 데이터를 챗봇에 복사-붙여넣기하고 있으며, 약 38%가 승인 없이 기밀 정보를 AI 플랫폼에 공유하고 있습니다.

IBM의 2025년 데이터 유출 보고서는 더 충격적입니다. 섀도우 AI(비인가 AI 사용)로 인한 데이터 유출 비용은 건당 평균 463만 달러로, 일반적인 유출 사고보다 67만 달러 더 높습니다. 전체 데이터 유출 사고의 20%가 섀도우 AI와 관련되어 있습니다.

3. API 키 및 결제 정보 노출

구매대행 업체를 통해 결제하면, 신용카드 정보나 API 키가 제3자에게 노출될 수 있습니다. API 키가 유출되면 무단 사용으로 인한 과도한 요금 청구가 발생할 수 있고, 해당 키를 통해 처리된 모든 데이터에 접근할 수 있게 됩니다.

Group-IB의 조사에 따르면, 2023년 1월부터 10월까지 다크웹에서 거래된 ChatGPT 유출 계정은 22만 5,000건에 달합니다. 이 계정들은 LummaC2, Raccoon, RedLine 등 정보 탈취 악성코드를 통해 유출되었습니다.

4. OpenAI 이용약관 위반 및 계정 정지

OpenAI 이용약관 제2조는 계정의 제3자 양도, 공유, 대여를 명시적으로 금지하고 있습니다. 무료 플랜에서는 1인 1계정 원칙이 적용되며, 유료 플랜에서도 계정 공유는 약관 위반입니다.

약관의 섹션 2, 5, 8, 9를 중대하게 위반하면 사전 경고 없이 계정이 정지될 수 있습니다. 구매대행을 통해 결제한 계정이 갑자기 정지되면, 축적된 대화 내역과 커스텀 GPT 등 모든 자산을 잃게 됩니다.

5. 관리자 권한 부재로 인한 보안 통제 불가

구매대행 계정은 관리자 콘솔(Admin Console)에 접근할 수 없는 경우가 대부분입니다. 이는 사용자 관리, 데이터 접근 제어, 사용 로그 확인 등 기본적인 보안 통제가 불가능하다는 의미입니다.

ChatGPT Team이나 Enterprise 플랜의 관리자 콘솔은 직원별 사용 현황 모니터링, 데이터 내보내기 제한, SSO(Single Sign-On) 설정 등 기업 보안에 필수적인 기능을 제공합니다. 구매대행 계정으로는 이러한 보안 기능을 전혀 활용할 수 없습니다. IT 솔루션 기업의 AI 업무혁신 워크숍 사례에서도 관리자 권한의 중요성을 강조한 바 있습니다.

실제 피해 사례로 본 ChatGPT 보안 사고

ChatGPT 관련 보안 사고는 이미 다수 발생했습니다. 구매대행 계정을 사용하면 이러한 위험이 더욱 증폭됩니다.

삼성전자 기밀 유출 사고

2023년 3월, 삼성전자에서 ChatGPT 사용을 허용한 지 불과 20일 만에 3건의 기밀 유출 사고가 발생했습니다. 임직원이 반도체 설비의 수율·불량 파악용 프로그램 소스코드를 ChatGPT에 입력하여 코드 최적화를 요청했고, 또 다른 직원은 회의 녹음 파일을 텍스트로 변환한 뒤 ChatGPT에 회의록 작성을 요청했습니다.

“ChatGPT에 내용이 입력되는 순간 데이터가 외부 서버에 전송되고 저장되어 회사가 이를 회수하는 것이 불가능합니다. 민감한 내용이 불특정 다수에게 제공될 수 있습니다.”

– 삼성전자 내부 공지 (2023)

삼성전자는 이후 전사적으로 ChatGPT 사용을 금지하고, 자체 AI 시스템 개발로 방향을 전환했습니다.

다크웹 ChatGPT 계정 대량 유출

Group-IB의 위협 인텔리전스 보고서에 따르면, 2023년 6월부터 10월까지 13만 건 이상의 ChatGPT 계정이 정보 탈취 악성코드에 의해 유출되었습니다. 이는 전반기 대비 36% 증가한 수치입니다. 2025년 2월에는 Malwarebytes가 2,000만 건의 OpenAI 계정이 판매용으로 올라온 사실을 확인했습니다.

OpenAI 측은 “이는 사용자 기기에 설치된 악성코드로 인한 결과이지, OpenAI 시스템 해킹이 아니다”라고 밝혔지만, 구매대행 계정의 경우 계정 관리 주체가 불분명하여 이러한 위협에 더욱 취약합니다.

한국 개인정보보호위원회의 OpenAI 제재

한국 개인정보보호위원회는 2023년 ChatGPT 서비스 이용자의 개인정보 유출에 대해 조사를 실시하고, OpenAI에 600만 원의 과태료를 부과했습니다. 이는 글로벌 AI 서비스에 대한 한국 정부의 첫 번째 제재로, 인공지능기본법이 시행되면 규제가 더욱 강화될 전망입니다.

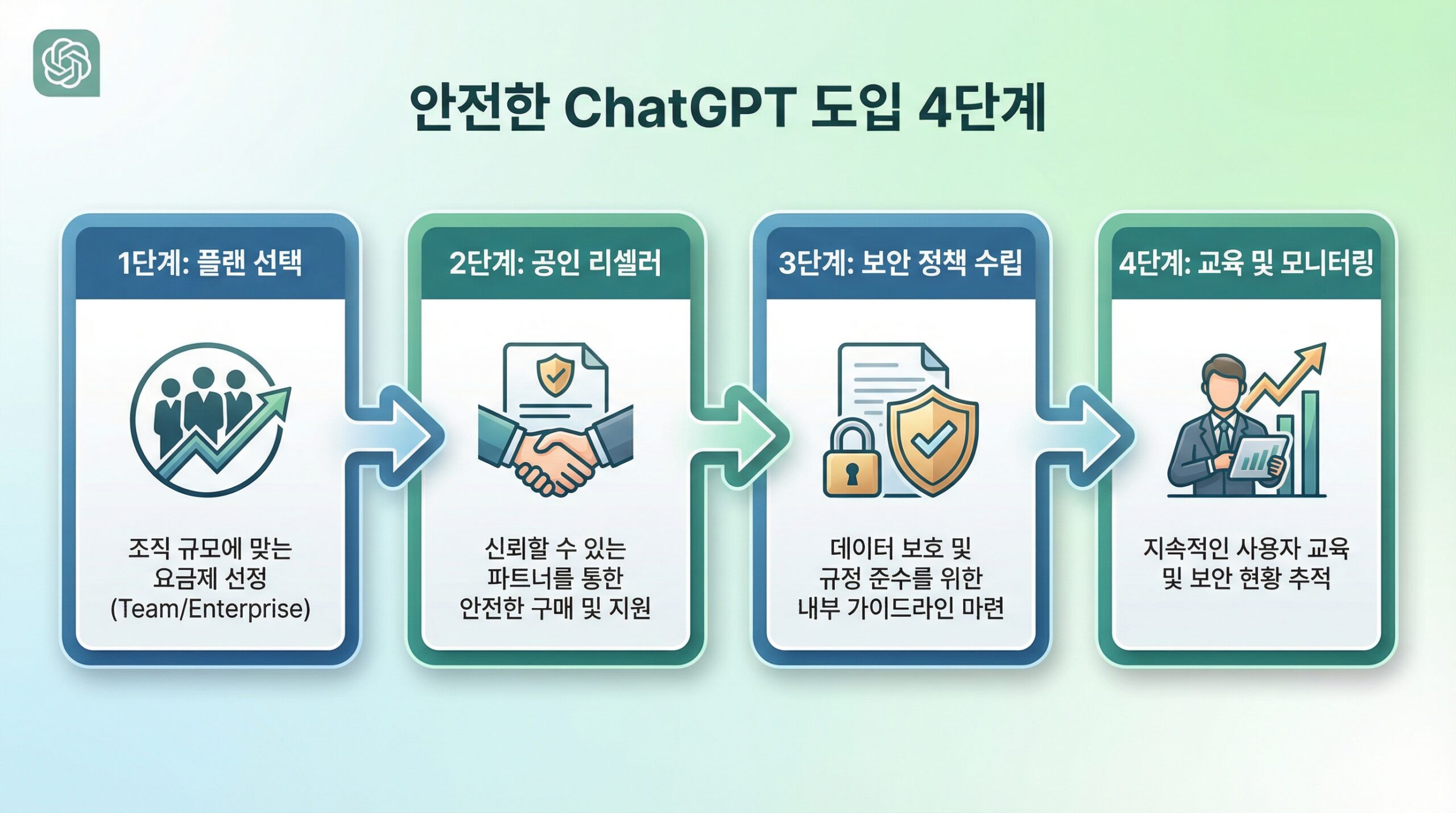

기업에서 ChatGPT를 안전하게 도입하려면 어떻게 해야 할까?

구매대행의 위험을 피하면서 ChatGPT를 효과적으로 도입하는 방법은 명확합니다. 공식 플랜과 공인 채널을 활용하는 것입니다.

ChatGPT Team vs Enterprise: 기업 플랜 비교

OpenAI는 기업용으로 Team 플랜과 Enterprise 플랜을 제공합니다. 두 플랜 모두 대화 데이터가 AI 학습에 사용되지 않으며, 관리자 콘솔을 통한 보안 관리가 가능합니다.

| 비교 항목 | Team 플랜 | Enterprise 플랜 |

|---|---|---|

| 최소 인원 | 2명 | 협의 필요 |

| 데이터 학습 제외 | 적용 | 적용 |

| 관리자 콘솔 | 기본 제공 | 고급 기능 포함 |

| SSO | 미지원 | SAML SSO 지원 |

| 데이터 암호화 | 전송 중 암호화 | 전송 중 + 저장 시 암호화 |

| 세금계산서 | 공인 리셀러 통해 가능 | 공인 리셀러 통해 가능 |

GPT 팀플랜 결제 시 가장 많이 묻는 질문을 참고하면 플랜 선택에 도움이 됩니다.

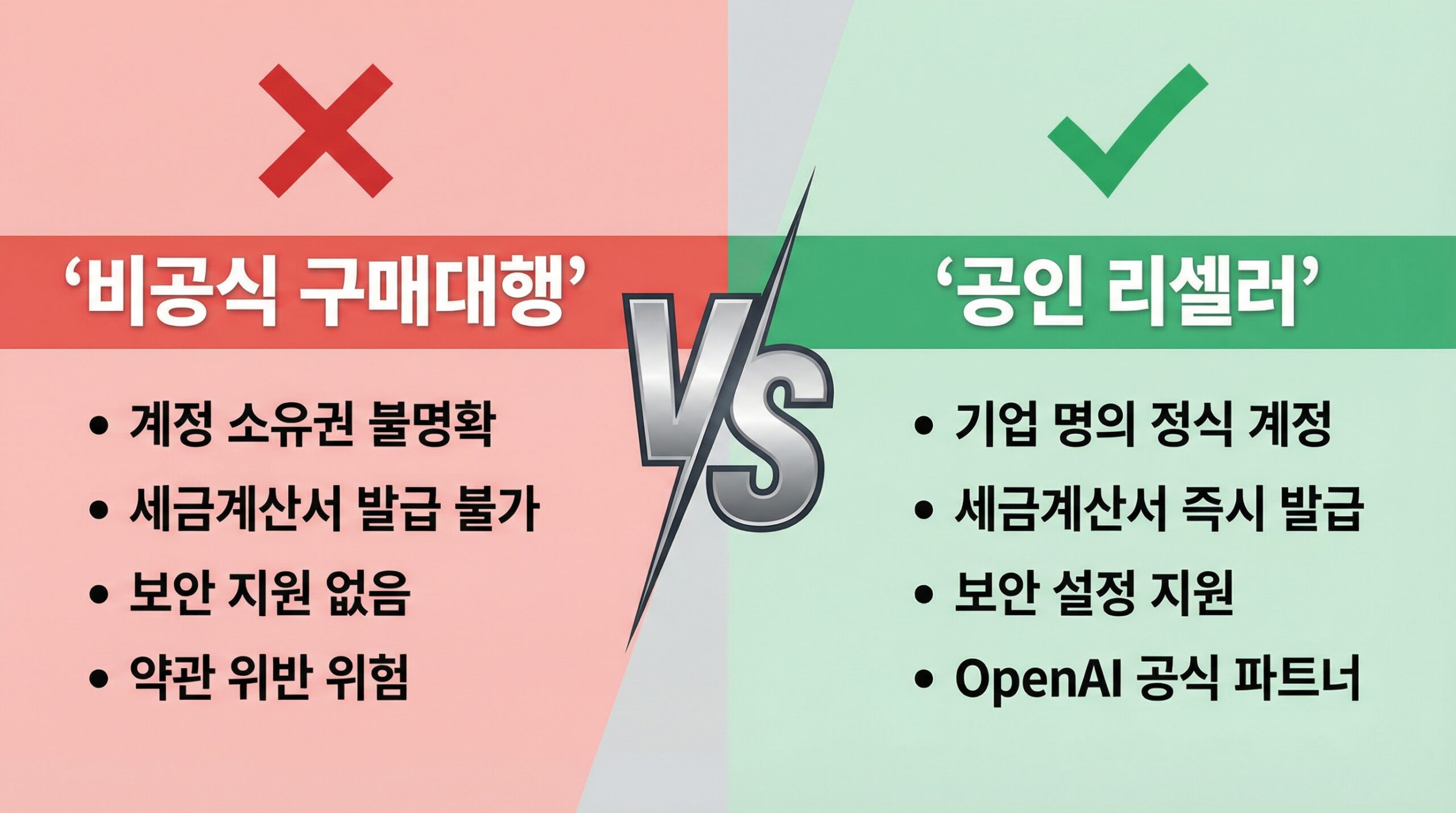

공인 리셀러를 통한 안전한 구매

OpenAI의 공인 리셀러(Authorized Reseller)를 이용하면 원화 결제, 세금계산서 발급, 기술 지원까지 한 번에 해결됩니다. 공인 리셀러는 OpenAI와 공식 파트너십을 맺고 있어 계정 소유권과 보안 책임이 명확합니다.

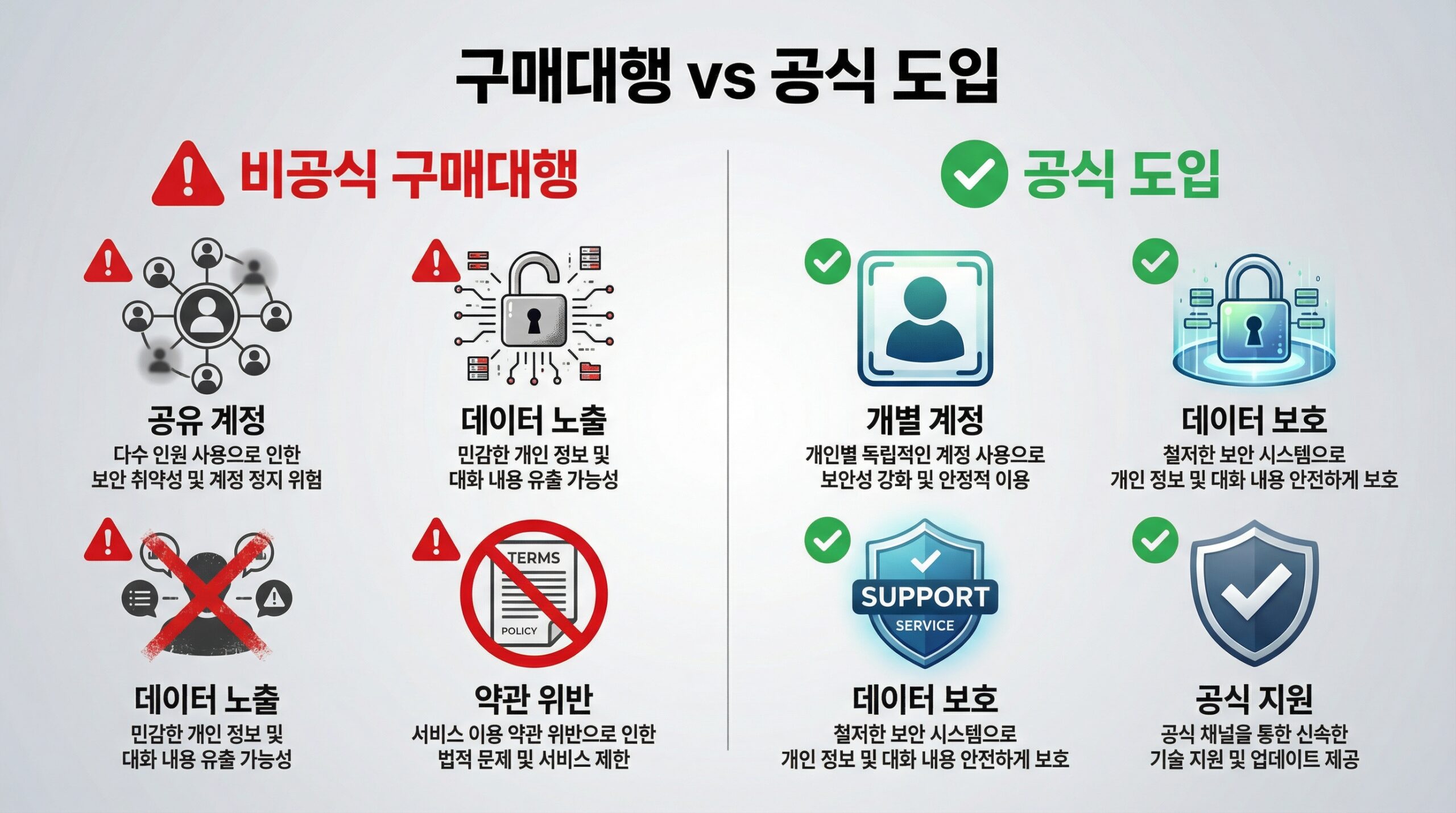

비공식 구매대행과 공인 리셀러의 결정적 차이점은 다음과 같습니다:

- 계정 소유권: 공인 리셀러는 기업 명의로 정식 계정을 발급하지만, 구매대행은 소유권이 불명확합니다

- 보안 지원: 공인 리셀러는 보안 설정, 관리자 콘솔 교육까지 지원하지만, 구매대행은 결제만 대행합니다

- 장애 대응: 공인 리셀러는 OpenAI와 직접 소통하여 장애를 해결하지만, 구매대행은 중간 단계가 추가되어 대응이 느립니다

- 세금 처리: 공인 리셀러는 정식 세금계산서를 즉시 발급하지만, 구매대행은 발급이 어렵거나 불가능한 경우가 많습니다

실제로 반도체 설계 전문 대기업의 GPT 대량 납품 사례에서도 공인 리셀러를 통해 보안과 회계 처리를 동시에 해결한 바 있습니다. 제미나이 구매대행 완벽 가이드에서도 공식 채널의 중요성을 확인할 수 있습니다.

기업 내부 AI 보안 정책 수립 4단계

KISA(한국인터넷진흥원)와 과학기술정보통신부의 ‘AI 보안 안내서’를 바탕으로, 기업이 수립해야 할 보안 정책은 다음과 같습니다:

- AI 사용 가이드라인 제정: 어떤 데이터를 AI에 입력할 수 있는지, 어떤 데이터는 절대 입력해서는 안 되는지 명확히 규정합니다

- 승인된 플랜만 사용: Team 또는 Enterprise 플랜만 업무에 사용하도록 하고, 개인 계정이나 공유 계정 사용을 금지합니다

- 정기적 보안 교육: 전 직원 대상으로 AI 사용 보안 교육을 실시하여 데이터 유출 위험을 인지시킵니다

- 사용 현황 모니터링: 관리자 콘솔을 통해 사용 패턴을 모니터링하고, 비정상적인 사용을 조기에 탐지합니다

이러한 체계적 접근 방식은 중소교육기업 D사의 ChatGPT Team 70석 도입 사례에서 성공적으로 적용된 바 있습니다.

구매대행과 공인 리셀러, 보안 관점에서 무엇이 다른가?

보안 관점에서 구매대행과 공인 리셀러는 근본적으로 다릅니다. 다음 비교표를 통해 핵심 차이를 확인하세요.

| 비교 항목 | 비공식 구매대행 | 공인 리셀러 |

|---|---|---|

| 계정 소유권 | 구매대행 업체 명의 (위험) | 기업 명의 (안전) |

| 데이터 접근 | 제3자 접근 가능성 | 기업만 접근 |

| 이용약관 | 위반 가능성 높음 | 완전 준수 |

| 세금계산서 | 발급 어려움 | 즉시 발급 |

| 장애 대응 | 간접 대응 (느림) | OpenAI 직접 연결 (빠름) |

| 보안 교육 | 미제공 | 도입 교육 제공 |

| 관리자 콘솔 | 접근 제한 또는 불가 | 전체 기능 사용 가능 |

특히 83%의 기업이 직원들의 AI 데이터 업로드를 탐지하거나 방지할 기술적 수단을 갖추지 못한 상황에서, 관리자 콘솔을 통한 모니터링은 선택이 아닌 필수입니다.

자주 묻는 질문

ChatGPT 구매대행은 이용약관 위반인가?

네, OpenAI 이용약관 제2조에 따르면 계정은 본인만 사용해야 하며 타인에게 양도하거나 공유할 수 없습니다. 구매대행 업체를 통한 계정 공유는 약관 위반으로, 계정이 정지될 수 있습니다.

구매대행으로 ChatGPT를 구매하면 데이터가 유출될 수 있나?

가능성이 높습니다. 공동구독 계정은 대화 내역이 다른 사용자에게 노출될 수 있으며, 구매대행 업체가 계정 접근 권한을 보유하는 경우 입력된 기업 데이터가 유출될 위험이 있습니다.

기업에서 ChatGPT를 안전하게 도입하는 방법은?

ChatGPT Team 또는 Enterprise 플랜을 공식 채널이나 공인 리셀러를 통해 도입하는 것이 안전합니다. Team 플랜은 대화 데이터가 AI 학습에 사용되지 않으며, 관리자 콘솔로 사용 현황을 모니터링할 수 있습니다.

ChatGPT 구매대행과 공인 리셀러의 차이점은?

공인 리셀러는 OpenAI와 공식 파트너십을 맺고 세금계산서 발행, 기술 지원, 보안 설정 지원까지 제공합니다. 반면 구매대행은 비공식 채널로 계정 관리 권한이 불분명하고 보안 책임 소재가 모호합니다.

ChatGPT 구매대행 시 세금계산서 발급이 가능한가?

대부분의 비공식 구매대행 업체는 정식 세금계산서 발급이 어렵습니다. 공인 리셀러를 이용하면 원화 결제와 함께 정식 세금계산서를 발급받을 수 있어 기업 회계 처리가 용이합니다.

결론: 비용 절약보다 보안이 먼저입니다

ChatGPT 구매대행은 단기적으로 비용을 절약할 수 있지만, 데이터 유출, 계정 정지, 법적 리스크라는 훨씬 큰 비용을 초래할 수 있습니다. 섀도우 AI로 인한 데이터 유출 비용이 건당 평균 463만 달러에 달하는 현실에서, 구매대행을 통한 비용 절약은 득보다 실이 큽니다.

기업이 ChatGPT를 도입할 때는 반드시 공식 플랜(Team/Enterprise)을 공인 리셀러를 통해 구매하고, 내부 보안 정책을 수립한 뒤 직원 교육을 병행해야 합니다. 이것이 AI를 안전하게 활용하면서도 업무 생산성을 높이는 유일한 방법입니다.

참고 자료

- Group-IB (2024), “Over 225,000 Compromised ChatGPT Credentials on Dark Web”, group-ib.com

- IBM (2025), “Cost of a Data Breach Report 2025: Shadow AI Risks”, ibm.com

- eSecurity Planet (2025), “77% of Employees Leak Data via ChatGPT”, esecurityplanet.com

- AI타임스 (2023), “삼성, 챗GPT 데이터 유출 후 임직원 AI 사용 금지”, aitimes.com

- 과학기술정보통신부·KISA (2025), “인공지능(AI) 보안 안내서”, kisa.or.kr

- Malwarebytes (2025), “20 million OpenAI accounts offered for sale”, malwarebytes.com

- AI매터스 (2025), “ChatGPT 한국 사용자 2,000만 명 돌파”, aimatters.co.kr

- 한국 개인정보보호위원회 (2023), “OpenAI 개인정보 유출 관련 제재 결정”, pipc.go.kr